Шокирующий рост этических нарушений в сфере искусственного интеллекта: будущее находится под угрозой!

За последние 10 лет количество этических нарушений, связанных с искусственным интеллектом, выросло в 26 раз, говорится в AI Index Report 2023. Этот отчет привлекает внимание к проблеме дипфейков, явлений, которые оказывают серьезное воздействие на общество и наносят ущерб авторитетным СМИ.

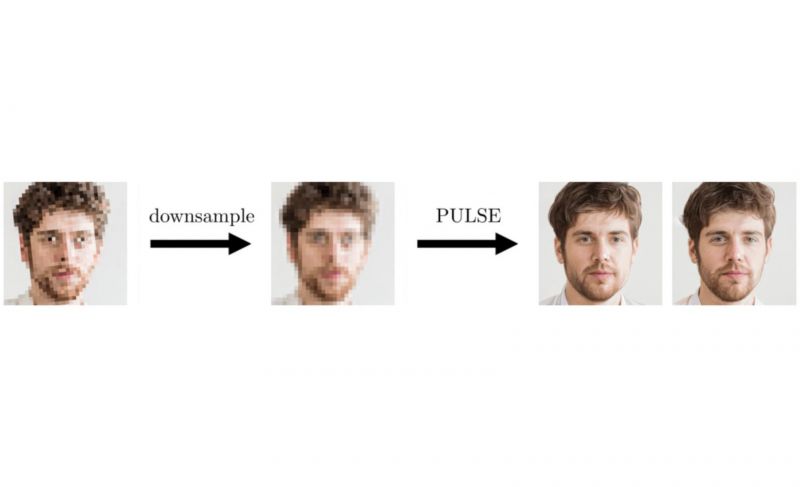

И если несколько лет назад дипфейком называли только замену лица в видео, то со временем это явление стало более разнообразным. Прародителем современных ИИ-моделей для создания дипфейков считается генеративно-состязательная нейросеть (GAN). Впервые эту модель представили в 2014 году. Так, одна нейросеть генерировала изображения, а другая их отбраковывала, если результат получался недостаточно реалистичным.

При этом в GAN нельзя было ввести запрос — нейросеть сама рисовала случайную картину на основе заложенных в нее образцов. Изначально генеративно-состязательная нейросеть могла создавать только небольшие изображения лиц в плохом качестве. Но вскоре GAN-модели научились создавать реалистичные картинки в 4K — некоторые из них уже было трудно отличить от реальных фотографий.

Считается, что первые дипфейки появились в 2017 году, когда на Reddit были опубликованы ролики откровенного содержания с лицами знаменитостей. Их выложил пользователь с никнеймом Deepfakes — поэтому слово и стало означать фальшивый контент. Следующий этап развития дипфейков наступил в 2021 году, когда компания OpenAI опубликовала первую версию нейросети DALL-E. Она генерировала реалистичные изображения уже по запросу. После этого ИИ-рынок наполнился аналогичными проектами, а в 2022 году Midjourney опубликовала в открытом доступе свою бета-версию.

Невероятные возможности дипфейков вызывают серьезное беспокойство. Использование поддельных видео и фотографий может привести к манипуляциям и ложной информации, порочащей общественное мнение. Иногда с помощью дипфейков можно обмануть даже авторитетные СМИ, что подрывает доверие общества к этим источникам информации.

Сложность в ситуации заключается в том, что с возрастанием технических возможностей искусственного интеллекта создание и распространение дипфейков становится все более доступным и незаметным. Это требует принятия соответствующих мер для обнаружения и борьбы с таким контентом.

Мнение сомневающегося эксперта:Однако, несмотря на все риски и проблемы, связанные с дипфейками, следует также учесть их потенциальные положительные аспекты. Я считаю, что важно не только критически относиться к возможному влиянию дипфейков на общество, но и видеть их как инструмент, который можно использовать для полезных целей.Во-первых, в мире развивающихся технологий дипфейки становятся новым способом артистического и творческого выражения. Использование нейросетей для создания уникальных и впечатляющих работ может быть искусством само по себе. Например, некоторые художники уже экспериментируют с созданием фотореалистичных портретов, которые никогда не существовали, но при этом захватывают воображение зрителя.Во-вторых, дипфейки могут стать полезным инструментом в образовательной среде. Создание реалистичных симуляций и виртуальных образов может помочь студентам и ученым в лучшем понимании и изучении различных процессов и явлений. Например, использование дипфейков может позволить студентам медицинских факультетов тренироваться на создании и анализе медицинских снимков, улучшая качество и эффективность обучения.Наконец, дипфейки могут быть полезными в сфере развлечений и киноиндустрии. Создание реалистичных визуальных эффектов и персонажей, которые ранее были невозможны или требовали длительного процесса создания, может принести новые возможности и впечатления зрителям. Это может помочь в создании более захватывающих и погружающих произведений искусства.Таким образом, несмотря на все озабоченности, связанные с использованием дипфейков, я считаю, что важно обратить внимание и на их потенциал в различных областях. Однако, чтобы избежать злоупотреблений и нанесения ущерба, необходимо разработать эффективные меры контроля, регулирования и обучения в области использования искусственного интеллекта и дипфейков.Реши свою проблему, спроси otvet5GPT

-

Быстро

Мгновенный ответ на твой вопрос -

Точно

otvet5GPT обладает знаниями во всех сферах -

Бесплатно

Задай вопрос и получи ответ бесплатно

Искусственный интеллект: Революция в мире труда и жизни уже здесь!

Технологии не впервые обещают изменить облик работы и повседневной жизни, однако масштабы и скорость воздействия искусственного интеллекта впечатляют. Мы, как лидеры, стоим на распутье: попытаемся ли мы укротить этот поток или научимся управлять его волнами? Игнорирование потенциала ИИ, его запрещение или централизованное использование недооценит его повсеместность и полезность.

Истинная сила искусственного интеллекта не в его сдерживании, а в демократизации — способности наделять индивидуальных новаторов и первопроходцев внутри организаций исследовать и использовать его возможности. Генеративный ИИ является особенным свидетельством технологической эволюции. В отличие от своих предшественников, таких как веб3, криптовалюты, NFT, виртуальная реальность и Метавселенная, чье влияние было спекулятивным и зависело от будущих разработок, влияние генеративного ИИ является немедленным и неоспоримым.

Исследование компании Accenture показывает, что ИИ может увеличить производительность бизнеса до 40%, позволяя людям более эффективно использовать свое время. В свою очередь, Всемирный экономический форум оценивает, что ИИ и автоматизация могут создать чистое увеличение рабочих мест на 58 миллионов, подчеркивая необходимость адаптации навыков работников в условиях меняющегося рынка труда, драйвом которого становятся технологии ИИ.

Опрос компании Gartner предсказал, что к 2023 году более 300 миллионов пользователей по всему миру начнут взаимодействовать с ИИ в повседневных задачах, что резко контрастирует с десятками миллионов в 2019 году. Это демонстрирует стремительную демократизацию технологий ИИ. Всего восемь месяцев назад ChatGPT стал частью массовой культуры, не просто как новинка, но как предвестник новой эпохи.

Однако, не все эксперты разделяют оптимизм, характерный для большинства аналитиков. В частности, Владимир Сидоров, ведущий специалист в области технологий и их влияния на занятость, высказывает свои опасения. "Несмотря на всеобщее восхищение искусственным интеллектом, я не могу игнорировать риски, связанные с его внедрением. Действительно, ИИ может повысить производительность, но также существует вероятность значительного сокращения рабочих мест, особенно для людей с низкой квалификацией", — говорит он.

Сидоров подчеркивает, что важным аспектом этой технологии является не только ее потенциал, но и необходимость обеспечения социальной безопасности для тех, кто может оказаться в уязвимой позиции. "Мы должны помнить, что новая волна автоматизации может оставить многих без работы, и обучение новым навыкам должно быть приоритетом для работодателей", — добавляет он.

В то же время, эксперты разделяют мнение о том, что интеграция ИИ должна быть сбалансированной. "Демократизация технологий — это хорошо, но важна также прозрачность алгоритмов и соблюдение этических норм", — резюмирует Владимир Сидоров. Он предостерегает о рисках, связанных с предвзятостью данных и их влиянием на принятие решений, которые могут дискриминировать определенные группы населения.

На фоне этих разногласий, становится ясно: мы находимся на пороге новой эры, где искусственный интеллект обещает быть не только союзником, но и достаточно сложным вызовом, требующим взвешенного подхода и активного участия всех заинтересованных сторон. В конечном счете, успех в этом переходе зависит не только от технологий, но и от нашего умения управлять последствиями их внедрения.

Apple Vision Pro: Революция или Новая Эра Технологий?

Искусственный интеллект: от невидимых помощников до революции в медицине!

Искусственный интеллект (ИИ) стал неотъемлемой частью нашей жизни, и в частности, генерирующий ИИ, такой как Midjourney и ChatGPT, завоевал широкую популярность за последние несколько лет. Однако стоит отметить, что научные исследования в области ИИ ведутся уже гораздо дольше, чем кажется на первый взгляд.

Многие полезные и важные приложения ИИ остаются в тени, несмотря на их значимость. Так, именно алгоритмы ИИ находят применение в различных отраслях, включая здравоохранение, потребительские технологии и даже сферы, вызывающие определённые опасения, такие как вооружение. Благодаря ИИ происходит настоящая революция в подходах к решению задач, которые ранее требовали много времени и ресурсов.

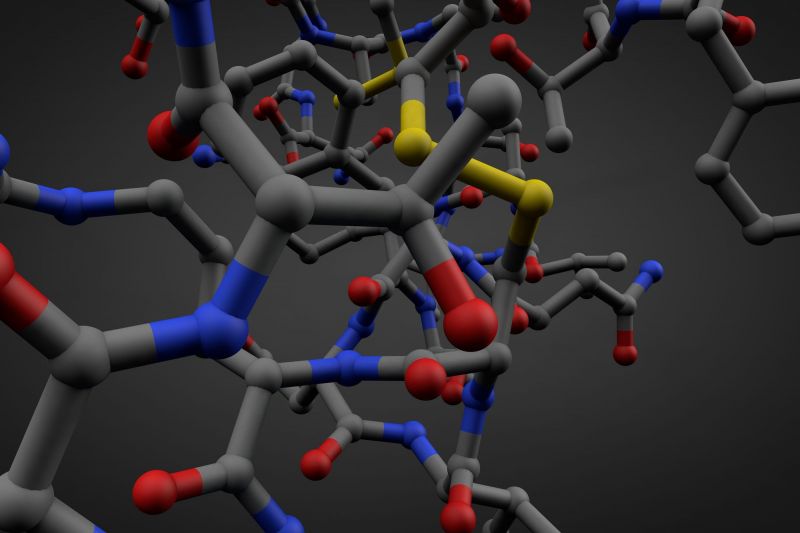

Одним из главных преимуществ технологий, основанных на ИИ, является их способность обрабатывать и анализировать огромные объемы данных за считанные секунды. Например, в области генетики ИИ помогает исследователям анализировать обширные генетические базы данных. Это позволяет ученым выявлять гены, которые могут быть связаны с определенными заболеваниями, а также разрабатывать новые диагностические тесты.

К тому же, ИИ ускоряет процесс поиска медицинских препаратов. Используя анализ больших данных, исследователи могут значительно сократить время на разработку новых лекарств, что в конечном итоге способствует улучшению качества медицинского обслуживания и спасению жизней.

Таким образом, искусственный интеллект открывает новые горизонты в медицине и других секторах, предвещая значительные изменения в будущем, которые могут преобразить жизнь миллионов людей по всему миру.

Тем не менее, несмотря на яркие достижения и перспективы, вызванные внедрением ИИ, ряд экспертов выражают сомнения относительно возможных рисков и этических вопросов, связанных с его использованием. Так, доктор Петр Соловьев, ведущий исследователь в области этики технологий, отметил, что высокий уровень автоматизации и зависимость от алгоритмов могут привести к нежелательным последствиям.

«Мы видим, что ИИ может существенно облегчить жизнь и улучшить процессы в медицине, но также необходимо учитывать, что это не избавляет нас от человеческого фактора», — говорит Соловьев. — «Например, потенциальные ошибки в интерпретации данных или принятии решений алгоритмами могут иметь серьезные последствия для пациентов. Кроме того, существует риск повышения неравенства, когда доступ к инновационным технологиям будут иметь только привилегированные слои населения. Это создаст дополнительные барьеры и может усугубить существующие социальные проблемы».

Также эксперт подчеркнул важность разработки четких этических стандартов в области ИИ: «Без надлежащего контроля и прозрачности технологии могут быть использованы в ущерб интересам общества, что недопустимо. Мы должны работать над тем, чтобы гарантировать, что ИИ будет служить во благо, а не во вред».

Слова доктора Соловьева подчеркивают необходимость комплексного подхода к внедрению ИИ и учёта потенциальных рисков. В конечном итоге, чтобы технологии действительно принесли пользу и изменение к лучшему, потребуется совместная работа ученых, разработчиков и регуляторов, способная обеспечить гармоничное сосуществование человека и машины в будущем.

Революция в образовании: Учителя примут ИИ на вооружение!

Ужасные вершины военной науки: как война поменяла искусство ведения боевых действий

С тех пор как война затянулась на два года, мир стал свидетелем резкого прогресса в области военной науки. Это выражается не только в новых технологиях, но и в изменении подходов к ведению боевых действий. Каждый день новости пестрят отчетами о потерях, и оглашают подробности атак, порой вызывая шок у телезрителей.

Недавно в эфире одной из телевизионных программ был показан репортаж о подготовке операторов беспилотников, так называемых "дроноводов". Эти молодые мужчины, в возрасте около 20-25 лет, обучаются маневрированию своих дронов через сложные каналы, имитирующие различные препятствия. На тренировочных занятиях они уверенно ведут беспилотные аппараты по извивающимся трубам, доставая их до конечной точки – цели. Учитывая масштабы конфликта, становится ясно, что навыки этих операторов могут быть востребованы не только сегодня, но и в будущем.

Однако, когда век боевых дронов подойдет к концу, что станет с этими молодыми людьми? Могут ли они вернуться к нормальной жизни, или же навыки, приобретенные в условиях войны, сделают их частью темной стороны общества? Отсутствие стабильности после конфликта может привести к разрушению старых устоев и появлению новых криминальных тенденций.

В этом контексте удивляет, насколько легко и быстро прогрессирует искусство ведения боевых действий. В отличие от времен холодной войны, когда снайперу требовалось рисковать, выцеливая цель на большом расстоянии, современное ведение боевых действий позволяет действовать более осторожно и эффективно, но при этом оно ставит под угрозу человеческое существование.

Неудивительно, что общество напрягается в ожидании, что же станет с безопасностью и нормой жизни после завершения конфликта. Таким образом, военные действия порождают не только страдания и разрушение, но и новые риски, которые могут стать реальностью уже в ближайшем будущем.

В середине этого сложного переходного периода возникают разные мнения о будущем "дроноводов" и новых технологических разработок. Некоторые эксперты уверены, что наличие высококвалифицированных операторов дронов в постконфликтной среде может привести к значительным изменениям в гражданской сфере, включая развитие новых направлений в промышленности и науке. Однако, другие предупреждают о рисках, связанных с их переходом в гражданскую жизнь.

Так, известный аналитик и эксперт в области безопасности, доктор Иван Михайлов, выразил свои сомнения в интервью нашей редакции: "Обученные в условиях войны операторы могут столкнуться с серьезными психологическими последствиями. Их навыки, изначально созданные для ведения боевых действий, могут быть перенаправлены на более темные дела, учитывая стрессы и эмоциональные травмы, которые они испытывали во время конфликта. Мы можем столкнуться с ситуацией, когда они превратятся не в созидатели, а в разрушители. Им будет трудно вернуться к нормальной жизни, и это может создать новые проблемы для общества".

С другой стороны, многие в индустрии технологий и стартапам считают, что такие специалисты могут стать ключевыми фигурами в разработке новых технологий, таких как системы автоматизированного контроля и дроны для гуманитарных миссий. Тем не менее, как отметили некоторые эксперты, время покажет, какая из этих перспектив станет реальностью, и как общество сможет интегрировать опыт "дроноводов" в мирную жизнь без рисков и угроз.

Таким образом, с одной стороны, мы наблюдаем за бурным прогрессом в военной науке, в то время как с другой — возникает множество вопросов о социальной адаптации молодых людей, прошедших школу войны. Неужели мир после конфликта все же будет plagued новыми вызовами, которые потребуют не менее тщательного стратегического планирования, чем тактика ведения боевых действий сегодня?

Искусственный интеллект угрожает будущему новостного бизнеса: как СМИ могут вернуть доверие

Искусственный интеллект (ИИ) начал оказывать значительное влияние на новостной бизнес, став не только инструментом, но и потенциальной угрозой для традиционного СМИ. По информации из недавней статьи, в которой рассматриваются проблемы современного информационного поля, новостные издания должны переосмыслить свои стратегии, чтобы вернуть доверие аудитории и занять свою нишу.

Исторически новостная индустрия всегда проявляла скептицизм к новым технологиям, будь то радио, телевидение или Интернет. Каждый раз, когда появлялась новая форма передачи информации, существующие СМИ теряли часть своей монополии. Проблема усугубляется с приходом генеративного искусственного интеллекта, который способен производить новости и контент в большом объеме с минимальными затратами.

Как показывает практика, скорость и доступность информации в интернете значительно снизили ценность традиционных печатных изданий. Ранее люди обращались к газетам, чтобы узнать результаты спортивных событий, расписания фильмов или новости о распродажах. Сегодня большинство пользователей легко находит аналогичные сведения в цифровом формате за считанные секунды.

Чтобы справиться с этой новой реальностью, новостным изданиям необходимо сосредоточиться на создании эксклюзивного контента и качественной верификации предоставляемой информации. Важно внедрять современные технологии, такие как инструменты анализа данных, которые помогут повысить эффективность работы редакций и лучше понимать потребности аудитории. Это не только улучшит качество публикуемых материалов, но и поможет вернуть доверие к СМИ среди читателей.

Таким образом, будущее новостного бизнеса зависит от способности медиаинституций адаптироваться к новейшим условиям и находить способы выделяться на фоне растущего потока контента, создаваемого ИИ.

Тем не менее, по мнению некоторых экспертов, такой оптимизм может быть преждевременным. Один из ведущих специалистов по медийным технологиям, доктор Игорь Смирнов, выразил сомнение в том, что новостные издания смогут быстро адаптироваться к изменениям, вызванным искусственным интеллектом. "Несмотря на все попытки журналистов создать уникальный контент, пользователи все равно подвержены искушению воспользоваться мгновенной информацией, предоставляемой ИИ", — отметил он. Смирнов добавил, что "доверие к традиционным СМИ продолжает снижаться, в то время как ИИ предлагает пользователям новостные материалы без каких-либо проверок фактов и подтверждений, что может создать серьезные риски для качества информации."

Далее он отметил, что в сложившихся условиях новостным изданиям необходимо не только улучшать качество контента, но и работать над своей репутацией, предоставляя аудитории дополнительную ценность, которой нет у систем, работающих на базе ИИ. "Мы должны задаться вопросом: как сделать новостное произведение не просто источником информации, а полноценным продуктом, который вызывает эмоции и создает диалог с читателем?" — подытожил Смирнов. Он предложил внедрять форматы, позволяющие аудитории участвовать в создании новостей, например, путем комментариев или взаимодействия через платформы социальных сетей.

Таким образом, противостояние традиционных медиа и искусственного интеллекта рисуется как сложный и многогранный процесс, в рамках которого новостные издания должны продемонстрировать свою уникальность, сохранив при этом качество и конфиденциальность предоставляемой информации. Путь вперед зависит не только от технологий, но и от понимания потребностей и ожиданий аудитории в этом изменяющемся информационном ландшафте.

Скандальная перепалка в мире криптовалют: основатель Cardano безжалостно высмеивает Solana

На прошлой неделе основатель Cardano Чарльз Хоскинсон неожиданно высмеял сеть Solana после того, как она пережила серьезный сбой. В то время как некоторые воспринимают это как безобидное подшучивание, другие считают комментарии Хоскинсона непрофессиональными и потенциально вредными для криптосообщества в целом.

Происшествие произошло всего через несколько дней после того, как Хоскинсон подверг критике возможности решений второго уровня (L2) для Bitcoin, вызвав бурную реакцию пользователей в социальных сетях. Данная ситуация стала частью нарастающих споров в мире криптовалют относительно гибкости и будущего архитектуры сети Bitcoin.

Слова Хоскинсона прозвучали на фоне недавних новостей от Муниба Али, соучредителя протокола Stacks, который делился обновлениями обсуждений на встрече Satoshi Round Table в Дубае. Хоскинсон утверждает, что архитектура Bitcoin не способна поддерживать динамичную среду, необходимую для успешных решений второго уровня, в отличие от текущих улучшений сетей Ethereum и Cardano.

Эти высказывания разожгли дискуссию в криптосообществе. Многие пользователи выразили свою поддержку Bitcoin, утверждая, что прочные фундаментальные принципы сети исключают необходимость внедрения новых функций для реализации L2 решений. Такая полемика подчеркивает острые разногласия и разные взгляды на развитие криптовалют в будущем.

Тем временем, в ответ на высказывания Хоскинсона, многие эксперты рынка начали высказываться по поводу его комментариев. Один из таких специалистов, профессор криптографии Андрей Смирнов, выразил сомнения в правильности оценки Хоскинсона. “Несмотря на существующие проблемы с сетью Solana, у нее есть свои достоинства и пользователи, которые сильно вложили свои ресурсы в эту платформу. Высмеивать другого игрока в условиях уже сложившейся конкурентной среды — это не лучший способ продвигать свою технологию и создавать здоровую экосистему”, — отметил он.

Смирнов также добавил, что критика решения второго уровня для Bitcoin может показаться справедливой, однако важно учитывать, что для многих пользователей сообщество Bitcoin по-прежнему остается первой и основной криптовалютой, и любое преувеличение проблем может навести тень на доверие к проекту. “Криптовалюты должны объединять, а не разъединять сообщества. Мы должны работать вместе, чтобы развивать технологии, а не ограничиваться суждениями и насмешками", — подытожил он.

Критика Хоскинсона не осталась без внимания, и его сторонники, в свою очередь, начали активно защищать его позицию, утверждая, что такая откровенность нужна для стимуляции дискуссий и улучшения существующих технологий. Тем не менее, даже среди его поклонников есть те, кто призывает к более конструктивному подходу в общении и сотрудничестве в рамках криптосообщества.

Пока споры продолжаются, рынок криптовалют остается непредсказуемым, и нарастающая полемика только подчеркивает необходимость понимания и анализирования различных точек зрения на будущее индустрии. Общий интерес к проблемам и достижениям в области блокчейн-технологий становится все более важным, даже в условиях острых разногласий и конкуренции.

Искусственный интеллект и будущее полупроводников: как новые технологии изменят отрасль

Новый уровень творчества: в России запустили мега-чат-ботa ChatHabAI!

В России запущен инновационный сервис ChatHabAI, который объединяет возможности нескольких мощных нейросетей, предоставляя пользователям уникальные инструменты для создания и редактирования контента. Этот чат-бот стал настоящим помощником для тех, кто стремится реализовать свои идеи в самых различных областях, от технологий до искусств.

Представители ChatHabAI сообщают, что сервис создан на основе обширных данных, что позволяет ему эффективно работать в разных направлениях. Пользователи имеют возможность взаимодействовать с разнообразными ИИ-продуктами, которые обеспечивают генерацию текста, создание изображений и их редактирование, всего с помощью простого текстового запроса.

В ChatHabAI включены такие известные нейросети, как ChatGPT от OpenAI, который известен своими впечатляющими возможностями генерации текста. Также в системе задействован продукт Gemini, который способен обрабатывать информацию в различных форматах – от текста до видео и аудио. Нейросеть Dalle3, известная своей точностью в генерации изображений, позволяет пользователям создавать визуальные концепции на основе словесного описания.

Кроме того, сервис включает Stable Diffusion, которая создает и редактирует изображения, а Prodia помогает генерировать графику по пользовательским описаниям. Все эти инструменты в одном месте делают ChatHabAI незаменимым помощником для творческих людей и профессионалов.

Тем не менее, несмотря на многообещающие возможности ChatHabAI, некоторые эксперты выражают опасения по поводу его применения. Один из них, независимый исследователь в области технологий и ИИ Игорь Петров, предполагает, что использование нескольких нейросетей одновременно может вызвать определенные сложности. "Многопрофильность может быть как сильной стороной, так и слабостью сервиса. Сложная система взаимодействия различных ИИ может привести к сбоям, ошибкам в интерпретации запросов пользователей и даже к потере интеллектуальной целостности генерируемого контента," — говорит Петров.

Он также указывает на уникальные ограничения каждой из нейросетей: "Хотя ChatGPT excels в генерации текстов, Dalle3 может столкнуться с трудностями, когда дело доходит до обработки более абстрактных концепций. Потребители могут столкнуться с ситуациями, когда различные компоненты сервиса не полностью соответствуют ожиданиям, и это может негативно сказаться на общем впечатлении".

Тем не менее, разработчики ChatHabAI уверены, что их алгоритмы достаточно продвинуты для решения подобных задач, и заверяют пользователей, что они продолжают активно работать над обновлениями и доработками системы. "Мы готовы оперативно реагировать на отзывы и улучшать функционал нашего сервиса, чтобы обеспечить наилучшее взаимодействие с пользователями," — утверждает один из представителей компании.

Остается только наблюдать, сможет ли ChatHabAI оправдать ожидания и стать настоящим помощником для творческих людей, или же вызовет больше вопросов, чем ответов. Время покажет, насколько удачным станет это нововведение на российском рынке инновационных технологий.

Денис Симачев и Сбербанк объединяют усилия для создания уникального дизайна с помощью ИИ